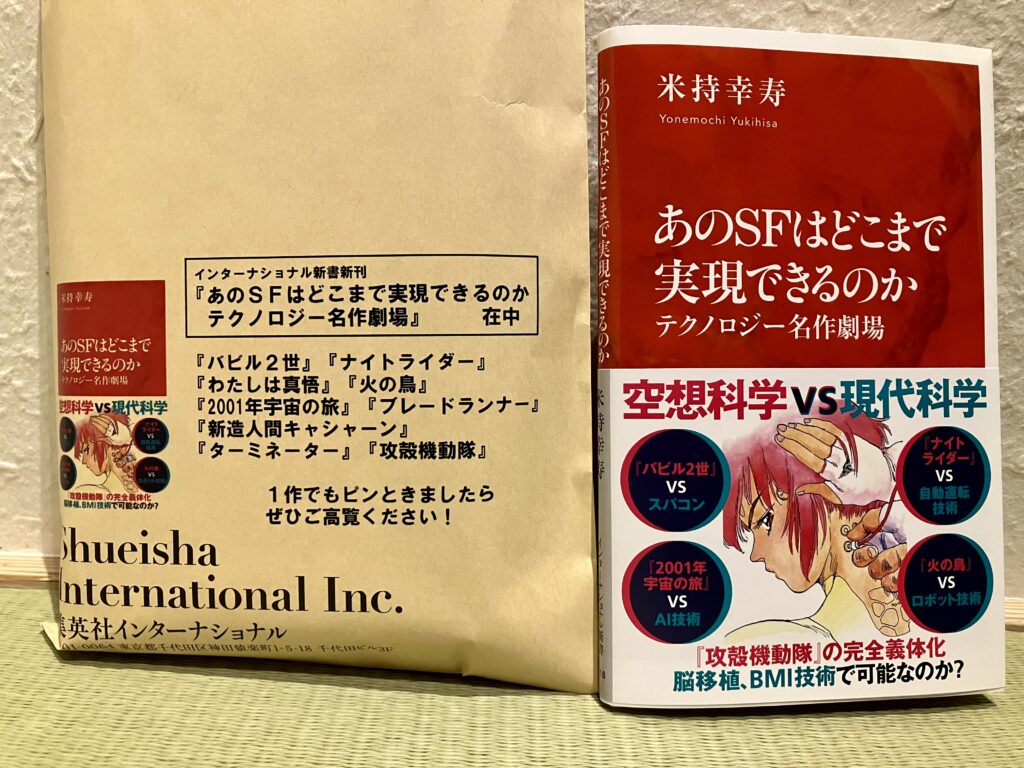

Pandrbox代表の米持 幸寿が執筆しております、@IT(アットマークアイティ)の自分戦略研究所で連載させていただいているテクノロジー名作劇場が、集英社インターナショナルの新書「あのSFはどこまで実現できるのか」として書籍化されました。

ネット記事には公開されていない書き下ろしのオリジナルコンテンツ「攻殻機動隊」も掲載されています。

ぜひお買い求めください。

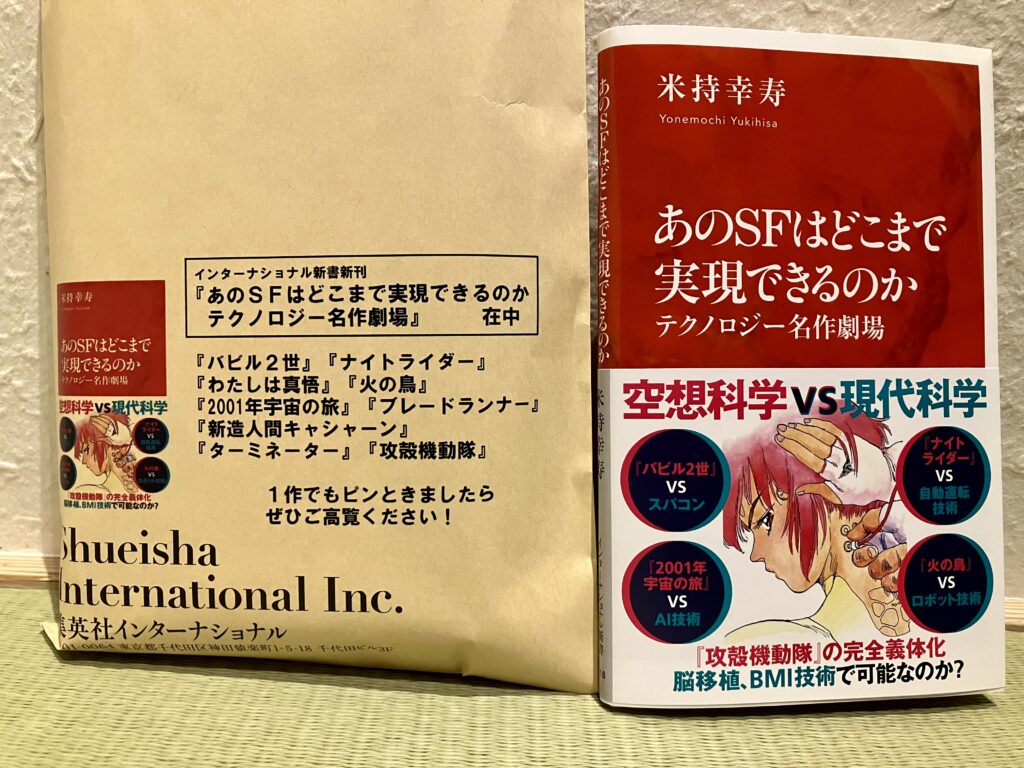

Pandrbox代表の米持 幸寿が執筆しております、@IT(アットマークアイティ)の自分戦略研究所で連載させていただいているテクノロジー名作劇場が、集英社インターナショナルの新書「あのSFはどこまで実現できるのか」として書籍化されました。

ネット記事には公開されていない書き下ろしのオリジナルコンテンツ「攻殻機動隊」も掲載されています。

ぜひお買い求めください。

本日2月2日はPandrbox創業記念日。今日で3年となりました。

現在試作に関わらせていただいている案件は、基本的な性能試験には無事合格し、現場投入に向けた作業が始まっています。今後も、音声対話インターフェースの社会実装に向けて活動してまいります。

論文が、International Journal of Informatics Society (IJIS) Vol. 14, No 1 にて公開されました。発行は2022年6月となっています。博士取得のキーとなった論文の一つです。

タイトルは、

Continual Lengthening of Titles: Implications for Deep Learning Named Entity Recognition

日本語では「長くなり続ける題名たち:深層学習固有表現抽出に対する示唆」です。

この論文では音声対話インターフェースを作成する際の語彙情報について議論しています。語彙情報の重要なものの一つに固有名詞があり、固有名詞のうちとくに小説、映画、漫画、アニメなどの「題名」に注目しています。これらの題名は年々長くなっています。過去のデータで学習した機械学習モデルでは、新しく発生した、より長い題名の検出に問題が発生することと、それに対して、検出時の特徴量に語彙情報を付加すると問題が軽減できる、という仮説のもと、データを整備し実験を行い、改善できることを示したものとなっています。

ご興味のある方はダウンロードしてご覧ください。

ひとつ前の投稿にある、Informatics Society(INFSOC)のInternational Workshop on Informatics(IWIN2021)でVerifications of Influence by Unknown Longer Titles of Work on Robustness of Deep Learning NER「深層学習による未知の長い作品題名の固有表現抽出の堅牢性への影響の検証」を報告させていただきました。こちらの論文に対して、Excellent Paper Awardを受賞いたしました。

Informatics Society(INFSOC)のInternational Workshop on Informatics(IWIN2021)で報告させていただきました。

日本語にすると、「深層学習による未知の長い作品題名の固有表現抽出の堅牢性への影響の検証」です。

第20回情報科学技術フォーラム(FIT2021)で報告させていただきました。

情報処理学会誌に論文を掲載していただきました。

こちらは、日本語に特化した研究となっています。

対話型インターフェースにおいて、入力文に含まれる語がデータベースにあるか確認する際、語の候補を作るにあたり総当たりをせず、形態素の境界と文字種の境界を組み合わせてヒット率の高い候補を作り出す方法を説明しています。この方法では、総当たりをしたときと比較して、最大96%検索量を削減でき、間違った語の検索も抑制できます。

対話型インターフェースのテキスト処理ではとても幅広い語を語彙として扱う必要があるため、外部の、あるいは遠隔の、データベースやLinked Open Data(LOD)を参照する必要があります。そのとき、こういったテクニックが役立ちます。

公立はこだて未来大学の「オープン技術特論」にて「音声対話インターフェース技術動向」として講義を行いました。例年は11月に大学内で行いますが、今年は新型コロナウィルス感染予防のため、zoomでの開催でした。

https://www.facebook.com/FunICT/posts/3774634412623566

2021年が始まりました。昨年スタートしたPandrbox、初年度から新型コロナウィルスによる世界が困難の中、なんとか1年乗り越えました。そして今年は年初からパソコン環境が壊れるという災難を受けまして、初日から新しいパソコンのセットアップというスタートとなりました。リフレッシュした新しいパソコンで心機一転、今年も頑張ります。

毎年秋になると恒例の「はこだて未来大学・高度ICT」の授業の季節がやってまいりました。本日より開始です。

今年で9年目となる学部4年生むけのこの授業、内容は「システム提案」を題材に、ITによる企業などの業務改善提案の考え方、提案書の作り方、説明の仕方などを学びます。学生の皆さんには実習で仮想提案を作ってもらい、提案書を書き、提案会としてプレゼンテーションをしていただきます。

技術題材としては、音声対話を企業活動に役立てる内容を考えていただきます。実際にデモも作っていただきます。

毎年この季節になると函館へ行き授業をやっていたのですが、今年はコロナ渦のためzoomで実施。自宅からの授業となっています。ですので、残念ながら活イカ、寿司、うに・イクラ、ジンギスカン、スナッフルスなどの写真はありません。